lunedì 15 giugno 2020

di s-mart.biz

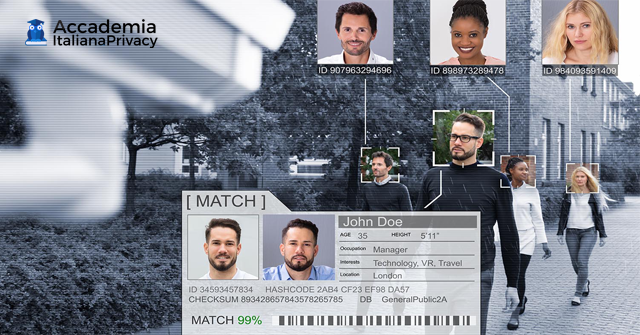

La tecnologia di riconoscimento facciale è tema che vede forte dibattito da anni: ne avevamo già parlato qui, in occasione della messa al bando da parte della città di San Francisco. E', nei fatti, una delle tecnologie più divisive dell'ultimo decennio, andando a toccare temi etici e politici molto delicati come la sorveglianza di massa, la profilazione razziale, il diritto alla privacy e così via... Anche l'efficacia degli algoritmi che ne permettono il funzionamento è messa in discussione, a partire dal fallimento della sperimentazione messa in atto dalla Polizia Inglese. Sono comunque già molteplici gli studi che dimostrano come il margine di errore di tali algoritmi sia ancora troppo alto.

Le proteste conseguenti all'uccisione di George Floyd a Minneapolis hanno travolto anche l'uso di questa tecnologia, messa sotto accusa dai manifestanti e contestata come forma di sorveglianza esageratamente invasiva e viziata da pregiudizi che producono una profilazione di tipo razziale. E' all'apice di questo difficile dibattito e in questo momento di grande tensione, che le decisioni di IBM e Amazon (le prime, Microsoft si è accodata poco dopo) piovono sul dibattito e suonano come un funerale (almeno temporaneo) per questa tecnologia.

Ibm è stata la prima a fare un passo indietro, dichiarando pubblicamente che non fornirà più software o servizi di riconoscimento facciale né al Governo né alle forze dell'ordine americane. La lettera di Arvind Krishna, amministratore delegato di IMB, è molto diretta: "Ibm si oppone fermamente e non perdonerà l’uso di alcuna tecnologia di riconoscimento facciale, comprese quelle offerte da altri fornitori, per la sorveglianza di massa, la profilazione razziale, le violazioni dei diritti umani e delle libertà o a qualsiasi fine che non sia coerente con i nostri valori e principi di fiducia e trasparenza".

48 ore dopo si accoda Amazon, che annuncia il divieto di utilizzo delle sue tecnologie di riconoscimento facciale da parte della polizia per un anno. “Esortiamo i governi a varare leggi più severe sull’uso etico di queste tecnologie di riconoscimento facciale”, questa la dichiarazione. La polizia USA utilizza la tecnologia Rekognition sulla quale, da più parti (perfino da alcuni azionisti), era stato sollevato il problema dell'assenza di una normativa chiara che ponesse limiti e margini all'uso tenendo di conto dei diritti costituzionali e delle normative privacy.

Chiude il cerchio Microsoft, che mette in standby la vendita di software per il riconoscimento facciale alla polizia USA. L'azienda ha dichiarato, nel corso di una conferenza virtuale del Washington Post che cesserà le vendite ”fino a quando non avremo una legge nazionale basata sui diritti umani che governerà questa tecnologia”. In questo caso, la decisione di Microsoft arriva dopo esplicita richiesta da parte di Joy Buolamwini, scienziata del Massachusetts Institute of Technology, che ha dimostrato con una serie di studi come il software Microsoft utilizzi criteri discriminatori in termini sia etnici che di genere.

E in Europa?

L'Unione Europea si è più volte espressa con preoccupazione rispetto a questo tipo di tecnologia, tantoché ad inizio anno era ventilata l'ipotesi di proibire l'uso di sistemi di riconoscimento facciale per un periodo di tempo tra i 3 e i 5 anni. Il ban alla fine non è stato varato, ma si sta comunque cercando di stabilire norme e limiti per l'uso sopratutto nei luoghi pubblici. Ad esempio, proprio in questi giorni, il Comitato Europeo per la Protezione dei Dati (EDPB) sta decidendo se dichiarare illegale la dibattutissima Clearview AI sul territorio europeo.

Dal banco alla banca dati: l’intelligenza artificiale tra mense, app e pubblicità

giovedì 4 dicembre 2025

Leggi tutto...

Leggi tutto...

CONDIVIDI QUESTA PAGINA!